Tecnologia

Projetando aprendizado de máquina mais seguro

As crianças que estão aprendendo a andar podem andar um pouco rápido demais e cair ou bater em um móvel. No entanto, esse elemento de causa e efeito ensina informações valiosas sobre como seus corpos se movem pelo espaço para que possam evitar quedas no futuro.

As máquinas aprendem da mesma maneira que os humanos, incluindo aprender com seus erros. No entanto, para muitas máquinas – como carros autônomos e sistemas de energia – aprender no trabalho com a segurança humana em jogo representa um problema. À medida que o aprendizado de máquina amadurece e prolifera, há um interesse crescente em aplicá-lo a sistemas autônomos altamente complexos e críticos para a segurança. A promessa dessas tecnologias, no entanto, é dificultada pelos riscos de segurança inerentes ao processo de treinamento e além.

Um novo trabalho de pesquisa desafia a ideia de que você precisa de um número ilimitado de tentativas para aprender ações seguras em ambientes desconhecidos. O artigo, publicado recentemente na revista Transações IEEE em Controle Automáticoapresenta uma nova abordagem que garante o aprendizado de ações seguras com total confiança, enquanto gerencia o equilíbrio entre ser ideal, encontrar situações perigosas e reconhecer rapidamente ações inseguras.

“Geralmente, o aprendizado de máquina procura a solução mais otimizada, o que pode resultar em mais erros ao longo do caminho. Isso é problemático quando o erro pode significar uma colisão com uma parede”, explicou Juan Andres Bazerque, professor assistente de engenharia elétrica e de computação na Swanson School of Engineering, que liderou a pesquisa junto com o professor associado Enrique Mallada da Universidade Johns Hopkins.

“Neste estudo, mostramos que aprender políticas seguras é fundamentalmente diferente de aprender políticas ótimas e que isso pode ser feito separadamente e com eficiência”.

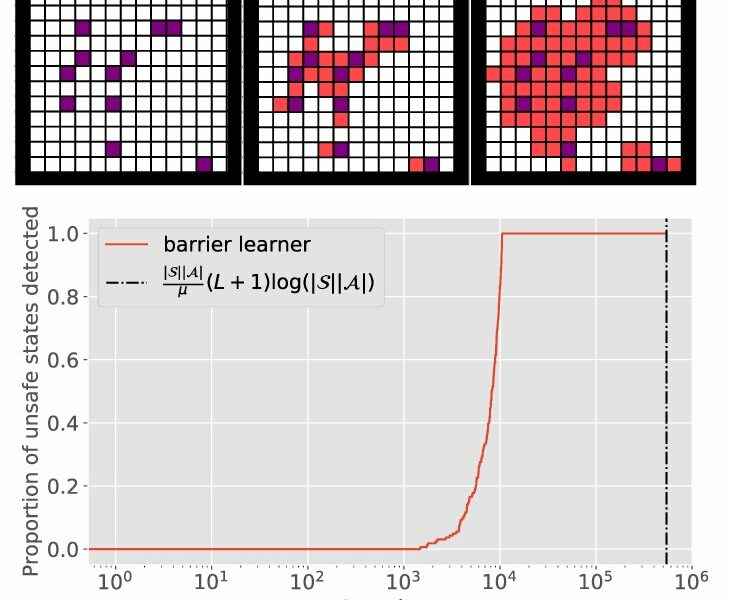

A equipe de pesquisa realizou estudos em dois cenários diferentes para ilustrar seu conceito. Ao fazer suposições razoáveis sobre a exploração, eles criaram um algoritmo que detecta todas as ações inseguras em um número limitado de rodadas. A equipe também enfrentou o desafio de encontrar políticas ideais para um processo de decisão de Markov (MDP) com restrições quase certas.

Sua análise enfatizou uma compensação entre o tempo necessário para detectar ações inseguras no MDP subjacente e o nível de exposição a eventos inseguros. O MDP é útil porque fornece uma estrutura matemática para modelar a tomada de decisões em situações em que os resultados são parcialmente aleatórios e parcialmente sob o controle de um tomador de decisão.

Para validar suas descobertas teóricas, os pesquisadores realizaram simulações que confirmaram as compensações identificadas. Essas descobertas também sugeriram que a incorporação de restrições de segurança pode acelerar o processo de aprendizado.

“Esta pesquisa desafia a crença predominante de que aprender ações seguras requer um número ilimitado de tentativas”, afirmou Bazerque. “Nossos resultados demonstram que, ao gerenciar com eficácia as compensações entre otimização, exposição a eventos inseguros e tempo de detecção, podemos obter segurança garantida sem um número infinito de explorações. Isso tem implicações significativas para robótica, sistemas autônomos, inteligência artificial e muito mais. ”

Mais Informações:

Agustin Castellano et al, Aprendendo a agir com segurança com exposição limitada e certeza quase certa, Transações IEEE em Controle Automático (2023). DOI: 10.1109/TAC.2023.3240925

Citação: Aprendizado de máquina mais seguro para engenharia (2023, 14 de junho) recuperado em 14 de junho de 2023 em https://techxplore.com/news/2023-06-safer-machine.html

Este documento está sujeito a direitos autorais. Além de qualquer negociação justa para fins de estudo ou pesquisa privada, nenhuma parte pode ser reproduzida sem a permissão por escrito. O conteúdo é fornecido apenas para fins informativos.

antenapolitica.com.br

-

Política6 dias atrás

Política6 dias atrásEduardo Leite é criticado por dizer que ‘grande volume de doações’ vai prejudicar o comércio do RS; veja o vídeo

-

Entretenimento1 semana atrás

Entretenimento1 semana atrásApós ser alvo de críticas em Porto Alegre, William Bonner toma atitude e decide se isolar em navio; veja vídeo

-

Entretenimento4 dias atrás

Entretenimento4 dias atrásTony Ramos: quadro de saúde do ator é revelado após cirurgia no cérebro

-

Entretenimento1 semana atrás

Entretenimento1 semana atrásHumorista não perdoa e “jornalismo” da Rede Globo vira piada; veja o vídeo

-

Política1 semana atrás

Política1 semana atrásViúvo da deputada Amália Barros faz emocionante desabafo; veja o vídeo

-

Entretenimento1 semana atrás

Entretenimento1 semana atrásBonner esbravejou e exigiu voltar para o RJ por medo, diz colunista

-

Entretenimento4 dias atrás

Entretenimento4 dias atrásTony Ramos é internado no Rio e passa por cirurgia no cérebro

-

Entretenimento5 dias atrás

Entretenimento5 dias atrásVendas de ingressos para turnê de Ivete e Ludmilla fracassaram